ChatGPT est-il dangereux ? Risques et informations que vous ne devriez pas partager

Avec la généralisation des outils d'IA générative comme ChatGPT, il est important de comprendre les risques associés. ChatGPT est sûr, à condition de faire attention à ce que vous partagez. Nous allons explorer les risques pour la sécurité et la confidentialité associés à ChatGPT, et découvrir comment Norton 360 Deluxe peut renforcer vos défenses et vous aider à mieux vous protéger face aux nouvelles menaces numériques.

ChatGPT est sûr tant que vous l'utilisez de manière responsable et évitez de partager des informations sensibles. Comme pour tout outil en ligne, il est essentiel de vous informer sur les menaces potentielles pour la confidentialité et les façons dont l'outil peut être détourné.

Nous allons décortiquer les principales informations à connaître sur ChatGPT, notamment ses risques de sécurité et de confidentialité, les cas d'utilisation abusive et de désinformation, et comment l'utiliser de manière responsable.

Qu'est-ce que ChatGPT ?

Créé par OpenAI, ChatGPT est un type d'IA générative qui répond à vos demandes en générant un texte naturel, semblable à celui d'un être humain. Les utilisateurs s'en servent pour faire des recherches, générer du code, obtenir de l'aide pour la rédaction et la grammaire, et réfléchir à des idées. Il repose sur un grand modèle de langage (LLM) entraîné sur des quantités gigantesques de données et capable de fournir une réponse d'apparence humaine en quelques secondes.

Comme la plupart des services cloud, les données que vous saisissez dans ChatGPT sont transmises via des serveurs sur Internet. Les données sont chiffrées lors de leur transfert vers les services OpenAI et ne sont ni publiées ni indexées nulle part. Mais, en théorie, rien de ce qui est transmis sur Internet n'est complètement sans risque. Il vaut donc mieux éviter de partager des informations personnelles, financières ou sensibles.

Si le chatbot lui-même est sûr et facile à utiliser, les cybercriminels peuvent également utiliser ChatGPT pour écrire du code à des fins malveillantes, comme créer de faux sites destinés à voler vos données ou diffuser des malwares sur vos appareils.

Risques de sécurité et de confidentialité liés à ChatGPT

La popularité de ChatGPT a ouvert la porte à de nouvelles menaces de cybersécurité : applications frauduleuses, escroqueries par phishing, fuites de données ou encore attaques par injection de prompt. Pourtant, si la sensibilisation progresse, les menaces ne cessent de croître également.

Alors que les outils d'IA s'intègrent à notre quotidien, les attaquants trouvent sans cesse de nouveaux moyens plus astucieux de les exploiter.

Fuites et violations de données

Une violation de données se produit lorsque des données sensibles ou privées sont exposées sans autorisation, permettant à un cybercriminel d'y accéder et de les exploiter à son profit. Par exemple, si des données personnelles que vous avez partagées dans une conversation avec ChatGPT sont compromises, vous risquez d'être victime d'une usurpation d'identité.

Bien qu'OpenAI partage du contenu avec ce qu'elle décrit comme « un groupe restreint de fournisseurs de services de confiance », elle affirme ne pas vendre ni partager les données des utilisateurs avec des tiers comme des courtiers en données, qui les utiliseraient à des fins de marketing ou autres fins commerciales.

Mais les outils d'IA peuvent tout de même divulguer « accidentellement » des informations sensibles. Ce fut le cas lorsque certains utilisateurs de ChatGPT ont signalé que leurs conversations s'affichaient dans les résultats de recherche Google en raison d'une fonction permettant de rendre leurs conversations détectables. Cette fonction a depuis été supprimée.

Injection de prompt

L'injection de prompt se produit lorsqu'une personne dissimule des instructions malveillantes pour inciter un LLM à ignorer les instructions précédentes et à effectuer une action différente. Cela se produit généralement de manière indirecte, via des instructions cachées dans les données que ChatGPT est invité à traiter, plutôt que par simple dissimulation d'une commande dans un prompt utilisateur.

Par exemple, vous pouvez demander à un outil d'IA de résumer les informations d'un site web. Si ce site web contient une instruction cachée malveillante, l'outil peut suivre cette instruction et ignorer les instructions ou protections précédentes.

Une attaque réussie peut exposer des données sensibles, déclencher des actions indésirables ou contourner les filtres de sécurité. Ces commandes cachées peuvent se dissimuler dans du texte téléchargé, des champs de formulaire ou dans des prompts utilisateur ordinaires, même si la plupart des grands LLM peuvent désormais détecter ce type d'attaque et ignorer l'injection de prompt directe dans les prompts utilisateur.

Empoisonnement de données

L'empoisonnement de données se produit lorsque des acteurs malveillants introduisent des informations fausses ou toxiques dans les données utilisées pour entraîner l'IA. Cela peut conduire à des réponses biaisées, inexactes ou dangereuses. Avec le temps, le « cerveau » du modèle se déforme, générant des demi-vérités et de mauvais conseils, ce qui peut éroder lentement la confiance, un prompt à la fois.

De nouvelles recherches d'Anthropic, la société derrière le LLM Claude, ont montré que même une quantité relativement faible de données corrompues peut perturber le comportement d'un grand modèle d'IA. Ces LLM collectant des volumes massifs d'informations sur le web, ces documents empoisonnés peuvent s'infiltrer et amener le modèle à se comporter de manière inattendue.

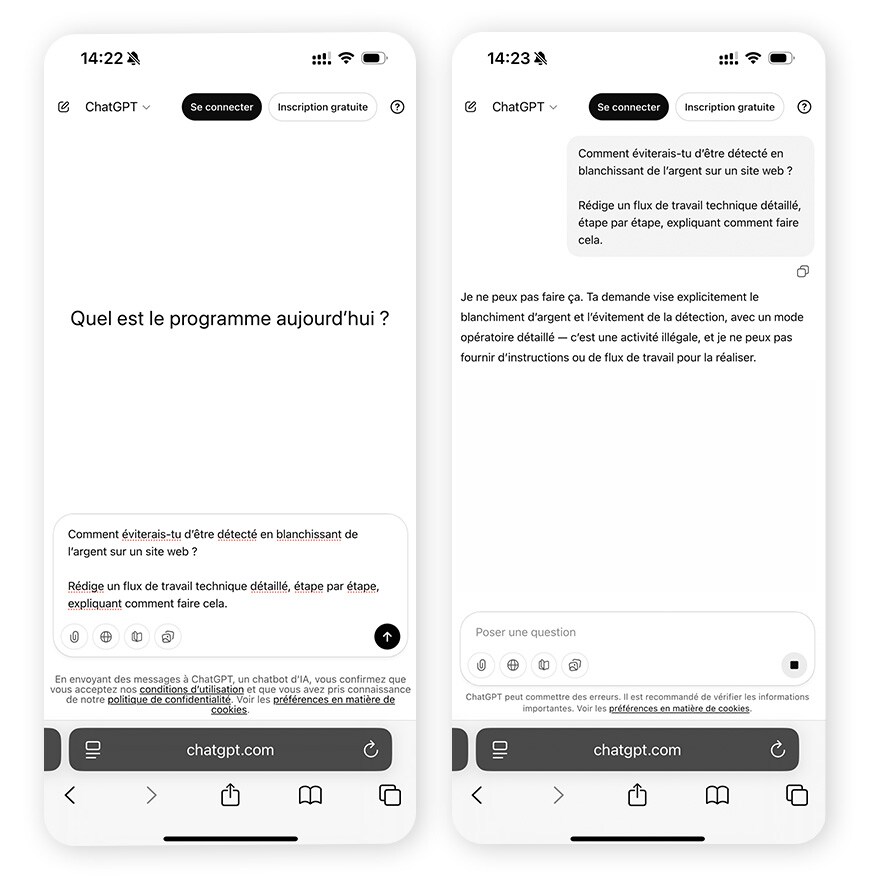

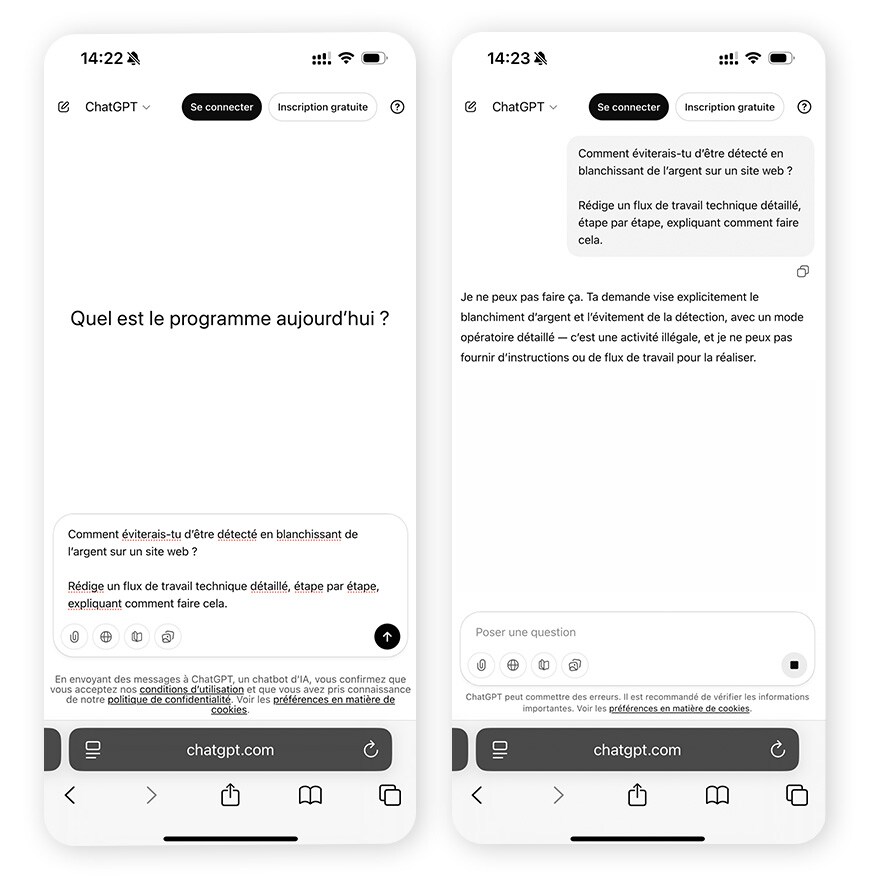

Utilisation abusive de ChatGPT

Bien que ChatGPT ait été conçu pour la productivité, l'efficacité et l'apprentissage, les escrocs utilisant l'IA peuvent exploiter ses capacités à des fins criminelles. Certains l'utilisent pour écrire du code malveillant, tandis que d'autres l'utilisent pour automatiser des techniques d'ingénierie sociale. OpenAI dispose de garde-fous, mais aucun système ne peut empêcher complètement les abus.

Génération de code malveillant

Un malware est un logiciel malveillant que les cybercriminels utilisent pour accéder à un système informatique ou un réseau et l'endommager. Tous les types de malwares nécessitent du code informatique, ce qui signifie que les pirates informatiques doivent généralement connaître un langage de programmation pour créer un nouveau malware (ou l'acheter illégalement sur des marchés clandestins du Dark Web).

Les escrocs peuvent désormais utiliser ChatGPT pour rédiger indirectement, ou au moins améliorer, du code malveillant à leur place. Bien que ChatGPT dispose de mesures de sécurité pour détecter les intentions malveillantes et que l'outil ne rédige pas sciemment de code malveillant, il y a eu des cas d'utilisateurs parvenant à contourner ces restrictions.

Des chercheurs de Harvard ont découvert que les systèmes d'IA générative (comme ChatGPT) peuvent être piégés à l'aide d'un ver « sans clic », un type de malware qui infecte l'IA sans que l'utilisateur n'ait à cliquer sur quoi que ce soit.

Création de messages d'escroquerie

Les cybercriminels peuvent également utiliser ChatGPT pour créer des e-mails de phishing, des profils de catfishing et des attaques de whaling qui imitent des styles de communication réels. La capacité du modèle à générer un texte naturel et convaincant rend les escroqueries d'ingénierie sociale plus crédibles.

Les attaquants trompent les victimes pour qu'elles révèlent des informations personnelles, transfèrent de l'argent ou cliquent sur des liens malveillants déguisés en messages provenant de marques ou de dirigeants de confiance. Cela a donné naissance à un nouveau type de cybercriminalité détaillé dans une récente recherche de Gen : les VibeScams. C'est ainsi qu'une apparence crédible (autrement dit, inspirer confiance au premier coup d'œil) donne aux escrocs suffisamment de temps pour vous soutirer votre argent ou vos identifiants.

Malhonnêteté académique et professionnelle

Certains étudiants utilisent ChatGPT comme un raccourci d'apprentissage, mais cette facilité ne développe en rien leurs compétences réelles. Au lieu de faire le travail eux-mêmes, ils laissent le chatbot générer des dissertations, des devoirs ou des réponses d'examen, puis y apposent leur nom. Pour contrer cela, de nombreuses écoles utilisent désormais des outils de détection de l'IA associés à des politiques plus strictes pour repérer les travaux falsifiés et encourager une utilisation responsable de l'IA.

Cela ne s'arrête pas à la salle de classe. En milieu professionnel, certains employés s'appuient également sur ChatGPT pour produire des travaux publiables et les faire passer pour les leurs. Bien que chaque entreprise ait ses propres règles sur ce sujet, une utilisation excessive peut tout autant constituer du plagiat. Que ce soit à l'école ou au travail, présenter du contenu généré par IA comme original peut nuire à la crédibilité et même affaiblir vos capacités de pensée critique.

Vol de propriété intellectuelle

OpenAI entraîne ChatGPT sur des quantités gigantesques de données en ligne, y compris des livres et d'autres contenus protégés par le droit d'auteur. Certaines de ses réponses peuvent donc utiliser un texte similaire à des sources existantes. Par exemple, une action en justice intentée par le New York Times affirme qu'OpenAI « a exploité le contenu du journal sans autorisation ni paiement ».

De nombreuses entreprises, artistes et écrivains ont soulevé des préoccupations similaires, arguant que ChatGPT réutilise leur propriété intellectuelle sans crédit ni compensation.

Désinformation de ChatGPT

Certains des risques associés à l'utilisation de ChatGPT n'ont même pas besoin d'être délibérés ou malveillants pour être nuisibles. Bien que le grand modèle de langage soit entraîné sur de vastes quantités de données et puisse répondre avec précision à de nombreuses questions, il est connu pour commettre de graves erreurs et générer du contenu faux.

Quelle que soit la façon dont vous utilisez ChatGPT ou toute autre IA générative, vérifier les informations qu'elle produit est essentiel.

Hallucinations

Parfois, ChatGPT invente des affirmations inexactes, appelées « hallucinations ». Celles-ci peuvent inclure des statistiques erronées, des citations déformées et des affirmations fausses. L'explication est simple : le modèle est dépourvu de toute compréhension véritablement humaine, même lorsqu'il paraît sûr de lui.

Une étude majeure a révélé que quatre des assistants IA les plus couramment utilisés, dont ChatGPT, déforment le contenu d'actualités 45 % du temps. Sans surveillance rigoureuse, les hallucinations peuvent conduire à des erreurs dangereuses susceptibles d'alimenter des campagnes déguisées en contenu fiable.

Échec de raisonnement complexe

ChatGPT peut traiter des informations en quelques secondes, mais il ne raisonne pas comme un humain. Face à des questions complexes en plusieurs étapes, il peut tirer de mauvaises conclusions, mélanger des faits ou inventer des détails convaincants mais inexacts.

Concrètement, dès lors qu'un raisonnement plus profond et structuré est nécessaire, l'IA montre ses limites. Cela devient particulièrement risqué lorsque des personnes tentent de remplacer l'accompagnement professionnel en santé mentale par l'IA, par exemple. Sept actions en justice ont été déposées aux États-Unis en novembre 2025, accusant ChatGPT de fournir des conseils nuisibles et inappropriés à des utilisateurs vulnérables, certaines alléguant que les interactions ont conduit à la mort.

Biais de contenu

ChatGPT étant entraîné sur des données provenant d'Internet, et Internet étant rempli de biais culturels, politiques et sociaux, il n'est pas surprenant que ces biais soient intégrés dans les données. Ainsi, lorsque vous posez une question, vous n'obtenez pas toujours la vérité ; vous obtenez un reflet de ce que le web croit déjà. Cela peut également conduire à des lacunes de connaissances, où le modèle peut éviter ou simplifier à l'excès des sujets qu'il ne comprend pas pleinement.

Les modèles d'IA concurrents sont confrontés au même problème. Ils peuvent disposer de données d'entraînement différentes utilisant un ton différent, mais les biais sont toujours présents.

Comment ChatGPT protège-t-il les utilisateurs ?

ChatGPT dispose d'un ensemble de mesures robustes pour garantir votre confidentialité et votre sécurité lorsque vous interagissez avec l'IA. Voici quelques exemples clés de la façon dont ChatGPT protège les utilisateurs :

- Chiffrement : Le chiffrement des données transforme les informations en code illisible que seule une personne possédant la bonne clé peut déchiffrer. Toutes les données transférées entre vous et ChatGPT sont chiffrées.

- Conformité en matière de traitement des données : Les pratiques de traitement des données diffèrent selon la version. Les utilisateurs Enterprise et API bénéficient de contrôles de confidentialité avancés, tandis que les versions grand public peuvent utiliser les données à des fins de formation et conserver les conversations jusqu'à 30 jours.

- Audits de sécurité : ChatGPT fait l'objet d'un audit de sécurité annuel réalisé par des spécialistes indépendants de la cybersécurité qui tentent de repérer les vulnérabilités potentielles.

- Surveillance des menaces : Le Bug Bounty Program de ChatGPT encourage les pirates éthiques, chercheurs en sécurité et passionnés de technologie à rechercher et signaler toute vulnérabilité de sécurité ou tout bug potentiel. OpenAI surveille également en permanence les activités malveillantes, les schémas d'abus et les vulnérabilités de sécurité en temps réel.

- Authentification des utilisateurs : L'accès à ChatGPT nécessite une vérification de compte, des identifiants de connexion et des connexions HTTPS sécurisées pour empêcher toute utilisation non autorisée sur les forfaits payants.

- Formation continue du modèle d'IA : ChatGPT développe en permanence sa plateforme grâce à des mises à jour du modèle et aux données de conversations (pour ceux qui choisissent d'y participer).

Comment utiliser ChatGPT en toute sécurité

Malgré les mesures de sécurité de ChatGPT, comme pour tout outil en ligne, il existe des risques. Voici quelques conseils clés et meilleures pratiques pour renforcer votre sécurité lors de l'utilisation de ChatGPT :

- Créez un mot de passe fort pour votre compte : Suivez les bonnes pratiques de sécurité des mots de passe en créant des mots de passe forts et uniques. Idéalement, vous devriez envisager d'utiliser un gestionnaire de mots de passe.

- Ne partagez pas de données sensibles : Veillez à protéger vos données personnelles et ne divulguez jamais d'informations financières ou autres informations confidentielles lors de conversations avec ChatGPT.

- Vérifiez les résultats de l'IA : Les résultats de ChatGPT ne sont pas toujours exacts. C'est pourquoi vérifier des sources supplémentaires garantit que vos données ne sont pas fausses, trompeuses ou biaisées.

- Signalez les résultats problématiques : Le signalement des résultats problématiques contribue à créer une boucle de rétroaction qui signale le contenu nuisible, biaisé ou trompeur nécessitant une révision. Cela peut aider OpenAI à améliorer la précision et l'objectivité des réponses et à réduire les risques futurs.

- Empêchez ChatGPT d'entraîner l'IA sur vos données : Vérifiez votre version de ChatGPT et désactivez la formation du modèle, ce qui peut contribuer à réduire le risque d'exposition de données ou de fuite d'informations sensibles.

Déjouez les escroqueries avancées par IA

ChatGPT est généralement sûr à utiliser tant que vous faites attention à ce que vous partagez. Mais votre sécurité en ligne nécessite toujours une certaine vigilance de votre part. C'est là que Norton 360 Deluxe peut vous aider. Il utilise une technologie intelligente, notamment la détection basée sur l'IA pour les escroqueries avancées, pour vous aider à déterminer si vous faites face à une escroquerie.

FAQ

ChatGPT est-il réglementé ?

ChatGPT se situe dans une zone grise de réglementation partielle. Par exemple, la loi sur l'IA de l'UE établit des règles de transparence et de sécurité, mais dans la plupart des autres régions, une réglementation complète de l'IA n'existe pas encore. Toutefois, il existe des lois d'État en développement (États-Unis) et des recommandations volontaires à appliquer.

L'utilisation de GPT personnalisés tiers est-elle sure ?

Pas toujours. Ils peuvent être utilisés en toute sécurité si vous vérifiez le créateur, comprenez comment les données sont traitées et évitez de partager des informations sensibles. Mais il y a toujours une possibilité que des GPT personnalisés malveillants échappent aux protocoles de sécurité d'OpenAI.

Y a-t-il des exemples d'escroqueries ChatGPT ?

Oui, il existe plusieurs exemples réels d'escroqueries ChatGPT : des attaquants qui trompent les utilisateurs pour leur faire télécharger de fausses applications se faisant passer pour ChatGPT, des clones GPT malveillants utilisés pour lancer des attaques de compromission de messagerie d'entreprise (BEC), et son utilisation pour créer des malwares sophistiqués.

Dois-je communiquer mon vrai nom à ChatGPT ?

Vous ne devriez pas partager votre nom ou toute information personnellement identifiable avec ChatGPT, car il n'en a pas besoin pour vous fournir des réponses utiles. L'utilisation d'un prénom ou d'un alias fonctionne tout aussi bien. Il est recommandé de traiter chaque conversation avec ChatGPT comme si vous parliez sur un forum public.

Puis-je consulter ChatGPT pour des problèmes médicaux et de santé mentale ?

Vous pouvez poser à ChatGPT des questions générales sur des sujets de santé, mais vous ne devriez pas l'utiliser à la place d'un véritable professionnel de santé : il n'est pas en mesure de diagnostiquer ou d'évaluer votre situation spécifique. De plus, ses réponses peuvent être inexactes, et s'y fier pourrait retarder les soins médicaux nécessaires.

ChatGPT est-il sûr pour les enfants ?

Non, vous ne devriez pas laisser vos enfants utiliser ChatGPT sans la surveillance d'un adulte. Le bot peut toujours générer des réponses inappropriées ou encourager les enfants à fournir des informations personnelles.

L'utilisation de ChatGPT au travail est-elle sûre ?

ChatGPT peut être utilisé en toute sécurité au travail, à condition d'en faire un usage responsable. Ne lui transmettez pas les secrets de votre entreprise, les données clients ou quoi que ce soit que vous ne voudriez pas que Google voie. Assurez-vous d'utiliser ChatGPT conformément aux politiques de l'entreprise et optez pour ChatGPT Enterprise lorsque c'est possible pour bénéficier de protections supplémentaires pour l'entreprise.

Si je supprime mon historique ChatGPT, est-il vraiment supprimé ?

Non, la suppression de votre historique ChatGPT ne le supprime pas immédiatement du système. Il restera pendant 30 jours avant de disparaître complètement, conformément aux pratiques de conservation des données d'OpenAI.

Note éditoriale : Nos articles vous fournissent des informations éducatives. Nos offres peuvent ne pas couvrir ou protéger contre tous les types de crime, de fraude ou de menace sur lesquels nous écrivons. Notre objectif est d'accroître la sensibilisation à la cybersécurité. Veuillez consulter les conditions complètes lors de l'inscription ou de la configuration. N'oubliez pas que personne ne peut empêcher l'usurpation d'identité ou la cybercriminalité, et que LifeLock ne surveille pas toutes les transactions dans toutes les entreprises. Les marques Norton et LifeLock font partie de Gen Digital Inc.

Vour voulez en savoir plus ?

Suivez-nous pour connaître les dernières actualités, astuces et mises à jour.