Deepfake : de quoi s'agit-il et comment le repérer ?

Les fausses vidéos et images hyperréalistes (« deepfakes ») sont de plus en plus difficiles à repérer et de plus en plus faciles à utiliser à mauvais escient. Presque impossibles à distinguer des vrais, ces faux générés par l'IA servent à tromper, escroquer ou manipuler des victimes qui ne se doutent de rien. Apprenez à reconnaître les « deepfakes » et franchissez le premier pas vers une meilleure sécurité en ligne. Allez encore plus loin en vous dotant d'une suite de sécurité alimentée par l'IA pour vous aider à détecter les « deepfakes » et autres menaces avancées.

Quelle est la définition d'un deepfake ?

Les deepfakes sont des vidéos, des images ou des clips audio générés par l'IA qui imitent de manière convaincante le visage, les expressions ou la voix d'une personne réelle. Créés à l'aide de techniques d'apprentissage profond, ils font souvent appel à des visages échangés, des paroles synthétisées et des séquences modifiées. Les « deepfakes » sont créés de manière si fluide qu'ils sont presque identiques au contenu authentique.

Alors que la technologie sous-jacente a été développée à l'origine pour le divertissement et la recherche universitaire, les deepfakes et autres outils d'IA sont de plus en plus exploités à des fins préjudiciables, telles que les escroqueries assistées par l'IA, l'usurpation d'identité, les campagnes de désinformation et même l'usurpation d'identité. Alors que la technologie devient de plus en plus avancée et accessible, les « deepfakes » constituent une menace sérieuse pour la confidentialité, la confiance du public et la sécurité numérique. Savoir les reconnaître et s'en protéger est désormais un élément essentiel de la sécurité en ligne.

Comment fonctionnent les deepfakes ?

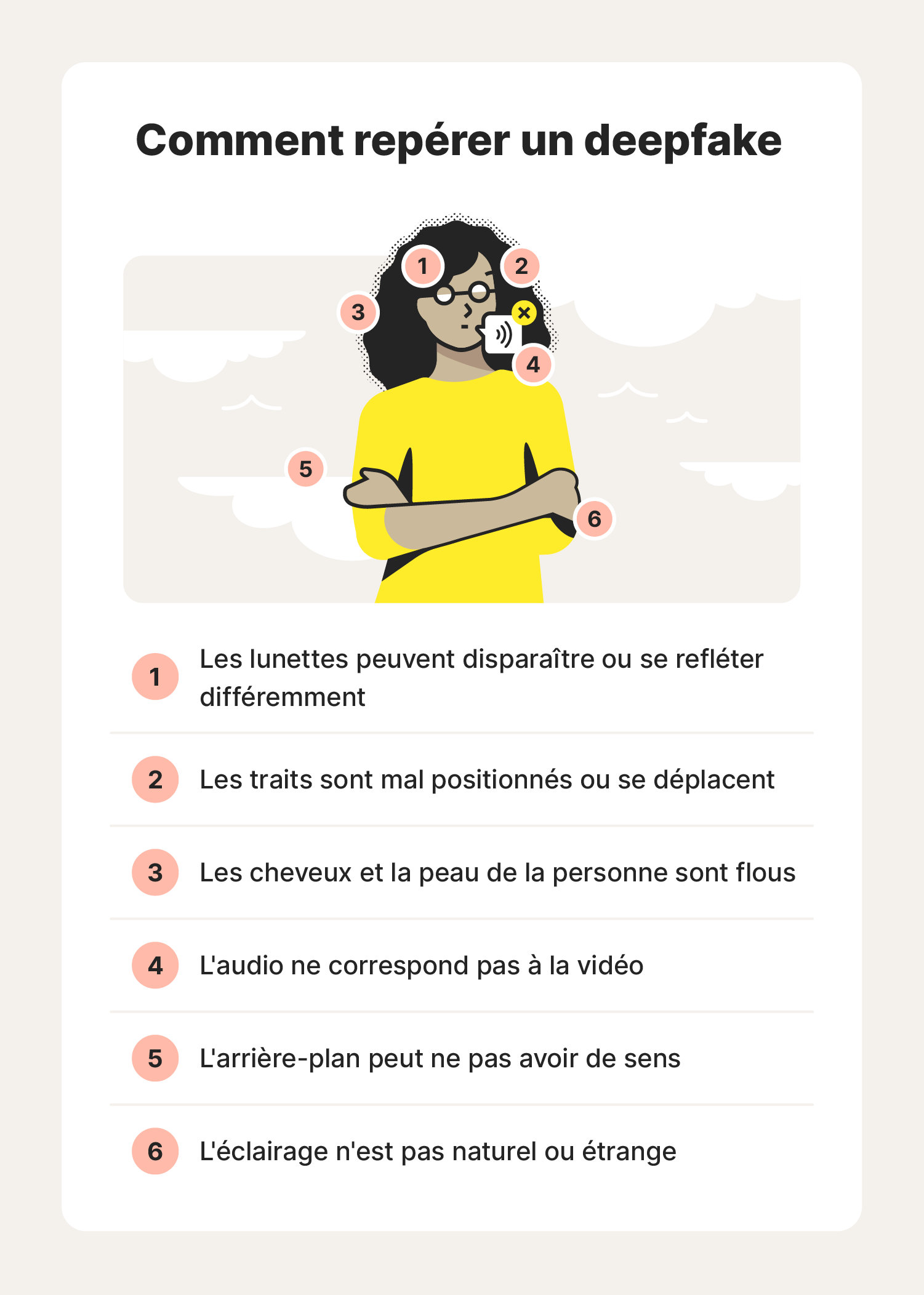

Les « deepfakes » combinent des images, des vidéos ou des enregistrements audio existants d'une personne dans un logiciel d'apprentissage profond alimenté par l'IA, ce qui permet aux fraudeurs de manipuler les informations pour en faire de fausses images, de fausses vidéos et de faux enregistrements audio.

Le logiciel est alimenté par des images, des vidéos et des clips vocaux de personnes qui sont traités pour « apprendre » ce qui rend une personne unique (de manière similaire à l'entraînement d'un logiciel de reconnaissance faciale). La technologie des deepfake applique ensuite ces informations à d'autres clips (en remplaçant une personne par une autre) ou s'en sert de base pour des clips entièrement nouveaux.

De quoi a-t-on besoin pour créer un deepfake ?

La technologie des deepfake est une combinaison de deux algorithmes : les générateurs et les discriminateurs. Les générateurs utilisent l'ensemble des données initiales pour créer (ou générer) de nouvelles images sur la base des données recueillies à partir de l'ensemble initial. Le discriminateur évalue ensuite le réalisme du contenu et transmet ses conclusions au générateur pour qu'il l'affine.

La combinaison de ces algorithmes est appelée « Generative Adversarial Networks » (GAN). Ils apprennent les uns des autres en affinant les entrées et les sorties de manière à ce que le discriminateur ne puisse pas faire la différence entre une image, un clip sonore ou une vidéo réels et ceux créés par un générateur.

Pour créer un deepfake, le logiciel spécialisé a besoin d'un grand nombre de vidéos, de sons et de photographies. La taille de l'échantillon de ces données est importante, car elle impacte directement la qualité ou la médiocrité d'un « deepfake ». Si le logiciel de deepfake ne dispose que de quelques images ou clips pour travailler, il ne sera pas en mesure de créer une image convaincante. Si le nombre d'images et de sons est plus important, le logiciel pourra créer un deepfake plus réaliste.

Lorsque la technologie d'IA génératrice de les deepfakes est apparue, la création de photos ou de vidéos réalistes nécessitait des logiciels coûteux, du matériel puissant et des compétences techniques avancées. Mais cette barrière est tombée. Aujourd'hui, les outils de « deepfake » sont largement accessibles (certains sont même gratuits) et peuvent fonctionner sur des appareils grand public ou sur des plateformes basées dans le cloud.

Quels sont les exemples d'utilisation de deepfakes ?

Les sociétés cinématographiques utilisent ces technologies pour :

- Rajeunir les acteurs (Harrison Ford dans Indiana Jones et Le Cadran de la destinée).

- Raconter des films après le décès d'acteurs (voix off d'Anthony Bourdain dans Roadrunner).

- Ressusciter des acteurs décédés pour des rôles dans de nouveaux films en combinant la performance d'un acteur vivant avec des recréations numériques d'acteurs originaux (Peter Cushing dans Star Wars : Rogue One ou Paul Walker dans Fast & Furious 7).

Il existe également des artistes amateurs d'effets visuels qui effectuent le même type de travail de manière informelle.

D'autres entreprises (les applications d'échange de visages, par exemple) créent de fausses applications pour les particuliers en plaçant leur ressemblance sur des acteurs célèbres dans des scènes de films et de télévision. La technologie utilisée pour ces applications est moins avancée que celle utilisée par Hollywood, mais elle est tout de même assez étonnante.

Les enseignants s'efforcent de créer de nouveaux supports pédagogiques qui permettent aux personnages historiques de s'adresser directement aux élèves afin d'approfondir les liens entre le passé et le présent. D'autres groupes se servent de cette technologie pour ramener à la vie des personnes aimées par le biais de messages vidéo et d'images.

Mais toutes les utilisations des technologies de « deepfake » ne sont pas inoffensives. Les criminels et les personnes malintentionnées exploitent de plus en plus les « deepfakes » à des fins qui vont du manque d'éthique à l'illégalité pure et simple. Avec la possibilité de faire croire que des personnalités publiques disent ou font n'importe quoi, les « deepfakes » peuvent servir à diffuser de la désinformation interférer dans les élections, manipuler l'opinion publique et saper la confiance dans les institutions.

À quoi servent les deepfakes ?

L'industrie du divertissement fabrique des « deepfakes » pour des films et des émissions de télévision, des sociétés d'applications proposent des échanges de visages pour des images et des clips vidéo, des individus et des organisations ayant des motivations politiques en créent pour diffuser de fausses informations, et même des criminels s'en servent à des fins de fraude et de chantage.

Une nouvelle tendance de la cybercriminalité consiste à utiliser de fausses vidéos de célébrités pour promouvoir de faux produits. Les personnes à l'origine de ces tactiques d'exploitation peuvent réaliser de fausses vidéos pornographiques, des vidéos de vengeance pornographique et des vidéos de sextorsion qui violent la confidentialité des personnes tout en gagnant de l'argent en vendant le matériel ou en menaçant de publier ces vidéos à moins du versement d'une « rançon ».

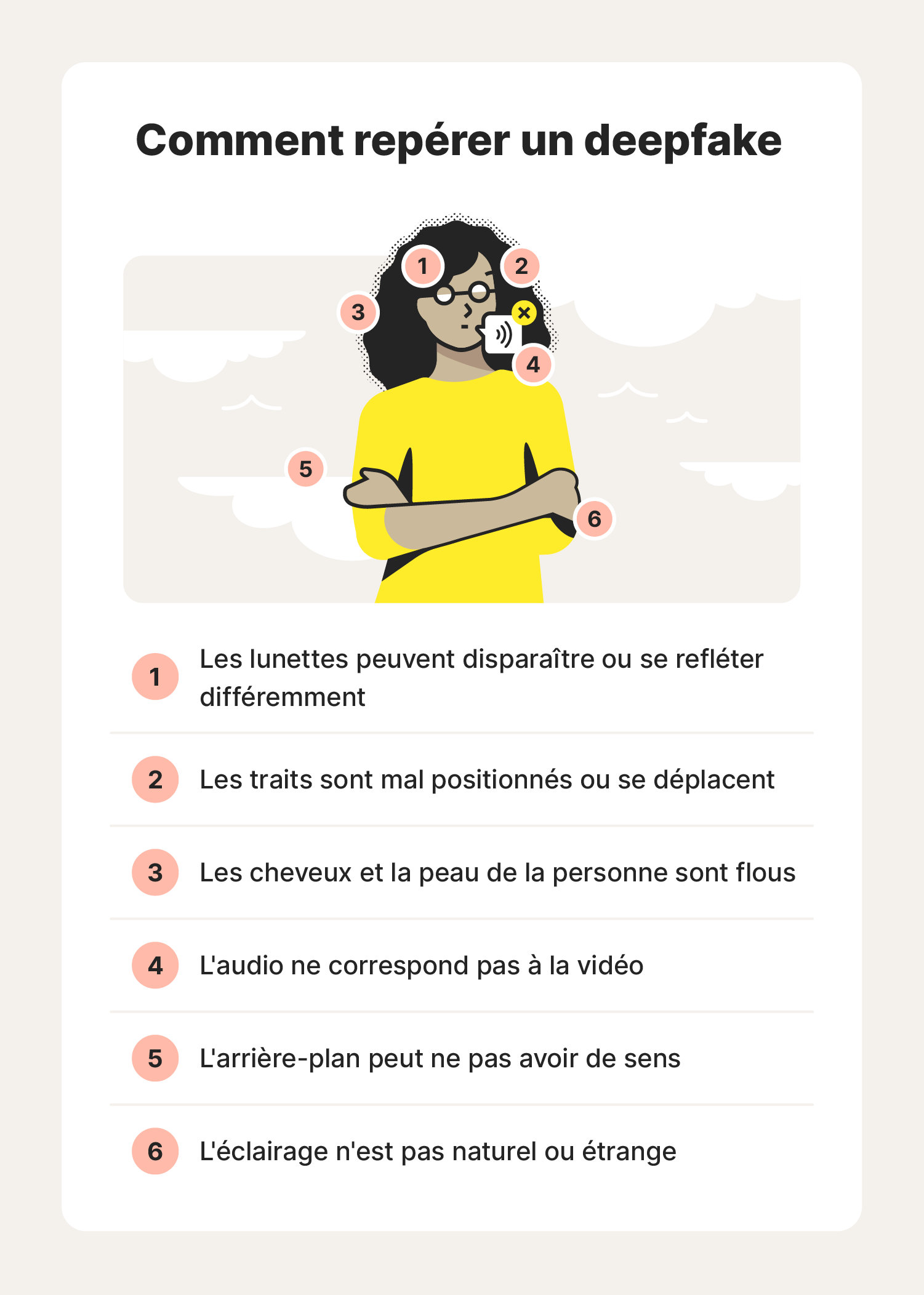

Comment repérer un deepfake

Il y a des choses assez simples que vous pouvez rechercher lorsque vous essayez de repérer un « deepfake » :

- Mouvements oculaires non naturels : Les mouvements oculaires qui ne paraissent pas naturels ou leur absence comme l'absence de clignement des yeux, sont des signaux d'alarme. Il est difficile de reproduire l'acte de clignement des yeux d'une manière qui semble naturelle. Il est également difficile de reproduire les mouvements oculaires d'une personne réelle. En effet, les yeux d'une personne suivent généralement son interlocuteur.

- Expressions faciales non naturelles : Quand quelque chose paraît anormal sur un visage, cela peut être le signe d'une manipulation faciale. C'est le cas lorsqu'un simple point d'une image a été effectué sur une autre.

- Positionnement maladroit des traits du visage : Si le visage d'une personne pointe dans une direction et son nez dans une autre, vous devez être sceptique quant à l'authenticité de la vidéo.

- Manque d'émotion : Vous pouvez également repérer la manipulation faciale ou les points d'image si le visage d'une personne ne semble pas exprimer l'émotion qui devrait aller de pair avec ce qu'elle est censée dire.

- Corps ou posture étrange : Un autre signe est que la forme du corps d'une personne ne semble pas naturelle ou que la tête et le corps sont positionnés de manière maladroite ou illogique. Il s'agit peut-être de l'un des aspects illogiques les plus faciles à repérer, car les technologies de deepfakes se concentrent généralement sur les traits du visage plutôt que sur l'ensemble du corps.

- Mouvements corporels non naturels : Si une personne semble déformée ou décalée lorsqu'elle se tourne sur le côté ou bouge la tête, ou si ses mouvements sont saccadés et décousus d'une image à l'autre, vous devez suspecter que la vidéo est fausse.

- Coloration non naturelle : Un teint anormal, une décoloration, un éclairage bizarre et des ombres mal placées sont autant de signes qui indiquent que ce que vous voyez est probablement faux.

- Cheveux qui n'ont pas l'air vrais : Vous ne verrez pas de cheveux crépus ou rebelles, car les images truquées ne sont pas en mesure de générer ces traits particuliers.

- Dents qui n'ont pas l'air vraies : Il se peut que les algorithmes ne soient pas en mesure de générer chaque dent, de sorte que l'absence de contours peut être un indice.

- Éléments flous mal alignés : Si les bords des images sont flous ou si les éléments visuels sont mal alignés , par exemple à l'endroit où le visage et le cou d'une personne rejoignent son corps, vous saurez que quelque chose ne va pas.

- Audio et son illogiques : Les créateurs de deepfakes consacrent généralement plus de temps aux images vidéo qu'à l'audio. Cela peut donner lieu à une mauvaise synchronisation des lèvres, une robotisation des voix, des prononciations de mots étranges, un bruit de fond numérique ou même l'absence de son.

- Images qui paraissent peu naturelles au ralenti : Si vous regardez une vidéo sur un écran plus grand que celui de votre smartphone ou si vous disposez d'un logiciel de montage vidéo capable de ralentir la lecture, vous pouvez zoomer et examiner les images de plus près. Un agrandissement sur les lèvres, par exemple, vous aidera à voir si la personne parle vraiment ou s'il s'agit d'une synchronisation médiocre des lèvres.

- Incohérences au niveaux des hashtags : Un algorithme cryptographique aide les créateurs de vidéos à montrer que leurs vidéos sont authentiques. L'algorithme permet d'insérer des hashtags à certains endroits d'une vidéo. Si les hashtags changent, vous devez soupçonner que la vidéo a été manipulée.

- Empreintes digitales : La technologie blockchain peut également créer une empreinte numérique pour les vidéos. Bien qu'elle ne soit pas infaillible, cette vérification basée sur la blockchain peut contribuer à établir l'authenticité d'une vidéo. Voici comment elle fonctionne. Au moment de la création d'une vidéo, le contenu est enregistré dans un registre immodifiable. Cette technologie aide à prouver l'authenticité d'une vidéo.

- Recherches d'images inversées : Une recherche d'image originale, ou une recherche d'image inversée à l'aide d'un ordinateur, permet de trouver des vidéos similaires en ligne afin de contribuer à déterminer si une image, un fichier audio ou une vidéo a été modifié de quelque manière que ce soit. Bien que la technologie de recherche vidéo inversée ne soit pas encore accessible au public, investir dans un outil de ce type pourrait être utile.

- La vidéo n'est pas diffusée par des sources d'information fiables : Si ce que dit ou fait la personne dans une vidéo est choquant ou important, les médias d'information en parleront. Si vous recherchez des informations sur la vidéo et qu'aucune source digne de confiance n'en parle, cela peut signifier qu'elle est un « deepfake ».

Au fur et à mesure de l'avancée des technologies de deepfaking, il devient de plus en plus difficile de l'identifier. Cela n'a pas empêché des groupes de scientifiques et de programmeurs de créer de nouveaux moyens d'identifier les « deepfakes ». Le Deepfake Detection Challenge (DFDC) encourage les solutions de détection des faux en encourageant l'innovation par la collaboration. Le DFDC partage un ensemble de données de 124 000 vidéos comportant huit algorithmes de modification des visages.

Il existe plusieurs outils de détection basés sur l'IA conçus pour repérer les deepfakes :

Les plateformes de réseaux sociaux X et Facebook ont interdit l'utilisation des deepfakes malveillants, et Google travaille sur des outils de conversion texte-parole pour vérifier les locuteurs.

Avec toutes ces ressources consacrées à la lutte contre les deepfakes, la lutte contre les escroqueries devient plus facile et plus rapide grâce à des solutions de détection des escroqueries basée sur l'IA, comme celles incluses dans Norton 360 Advanced. En effet, cette solution se sert de cette forme d'intelligence de pointe pour détecter les manipulations vidéo et les intentions frauduleuses, en vue de faire bénéficier l'utilisateur d'une protection rapide et fiable contre les deepfakes et autres techniques d'escroquerie en ligne.

Comment se protéger des deepfakes ?

Se protéger des « deepfakes » revient à se protéger d'autres menaces potentielles en ligne. Pour contribuer à éviter que d'autres n'utilisent votre image dans un « deepfake » :

- Limitez le nombre de photos et de vidéos de vous et de vos proches que vous partagez.

- Réglez vos profils de médias sociaux sur « privé ».

- Utilisez un VPN lorsque vous utilisez Internet.

- Utilisez un logiciel de blocage des virus.

- Demandez aux membres de votre famille d'utiliser un mot de code pour s'identifier en cas d'urgence.

- Conduisez vos affaires vous-même, surtout de l'argent passe de mains en mains.

Bien qu'il n'y ait aucun moyen d'éliminer complètement les risques d'être victime d'une escroquerie de type « deepfake », le fait de prêter une attention particulière à ce que vous mettez en circulation peut faire la différence.

Renforcez la protection de votre identité contre les deepfakes

Pour éviter les « deepfakes » et les escroqueries qu'ils permettent, il est essentiel de faire preuve de prudence quand vous naviguez, que vous effectuez des achats ou que vous communiquez sur Internet. Pour une protection plus forte, souscrivez à Norton 360 Advanced. Cette solution est dotée d'une technologie avancée d'intelligence artificielle permettant de détecter les deepfakes et les escroqueries, qui peut vous alerter en temps réel en cas de menace. De plus, vous bénéficierez d'une assistance pour rétablir votre identité et vous guider à travers les étapes en cas d'usurpation d'identité.

FAQ

Les « deepfakes » sont-ils détectables ?

Oui, les deepfakes sont détectables, mais ce n'est pas toujours facile. Vous pouvez identifier un deepfake à l'œil nu en restant attentif aux expressions faciales bizarres, aux ombres qui ne correspondent pas ou aux problèmes de synchronisation audiovisuelle. Les outils de détection alimentés par l'IA peuvent contribuer à identifier les aspects illogiques révélateurs, les « empreintes » de deepfake et autres signes de manipulation.

Un deepfake est-il un cas d'usurpation d'identité ?

Un deepfake n'est pas en soi un cas d'usurpation d'identité, mais il peut servir dans le cadre d'une escroquerie de phishing ou d'un vol d'identité donnant lieu à une usurpation d'identité, en incitant quelqu'un à partager des informations privées.

Les « deepfakes » représentent-ils vraiment une menace pour la sécurité ?

Potentiellement, oui. À mesure que la technologie des deepfakes devient plus avancée et accessible, elle peut être utilisée pour diffuser de la désinformation, usurper l'identité de personnalités publiques, perturber des élections ou mener des escroqueries, ce qui en fait une préoccupation de plus en plus aiguë sur le plan de la sécurité.

Qui est concerné par les deepfakes ?

Presque tout le monde peut être affecté par les deepfakes. Vous pouvez tomber sur une fausse vidéo et la croire réelle ou, pire encore, être confronté à quelqu'un qui crée un deepfake de vous et le partage sans votre consentement. Qu'il s'agisse de personnalités publiques ou de particuliers, les « deepfakes » représentent un risque pour la réputation, la confidentialité et la confiance.

Note éditoriale : Nos articles vous fournissent des informations éducatives. Nos offres peuvent ne pas couvrir ou protéger contre tous les types de crime, de fraude ou de menace sur lesquels nous écrivons. Notre objectif est d'accroître la sensibilisation à la cybersécurité. Veuillez consulter les conditions complètes lors de l'inscription ou de la configuration. N'oubliez pas que personne ne peut empêcher l'usurpation d'identité ou la cybercriminalité, et que LifeLock ne surveille pas toutes les transactions dans toutes les entreprises. Les marques Norton et LifeLock font partie de Gen Digital Inc.

Vour voulez en savoir plus ?

Suivez-nous pour connaître les dernières actualités, astuces et mises à jour.